Malgré une inquiétude des développeurs, la version finale du logiciel de Open AI est disponible pour les entreprises avec une surveillance de l’utilisation.

GPT-3 : un logiciel de rédaction hyperperformant

Une capacité d’évolution et d’apprentissage caractérise ce nouveau logiciel (à ne pas confondre donc avec les algorithmes de Google) utilisant l’intelligence artificielle. Cofondé par Elon Musk en 2015, Open AI est un centre de recherche d’intelligence artificielle à but non lucratif . « Notre but est de faire progresser l’intelligence numérique dans une direction plus à même de bénéficier à l’humanité », a expliqué l’organisation lors de sa création sur son site internet.

GPT-3 est la nouvelle API (interface de programmation) de Open AI. Il s’agit d’un générateur de texte permettant de rédiger automatiquement des articles en anglais, de traduire des textes et d’analyser des écrits. Ce logiciel pourrait être utilisé en entreprise afin de programmer des réponses pour les chatbots ou d’écrire des articles automatiquement. Pour le grand public, les réseaux sociaux ou les sites internet pourraient l’utiliser comme outil de modération des messages postés.

Open AI « espère que cette API permettra d’abaisser les barrières à la production de produits IA bénéfiques, et donnera naissance à des outils et services difficiles à imaginer aujourd’hui ». Néanmoins, une utilisation avec de mauvaises intentions pourrait porter préjudice, voire être dangereuse.

Les potentiels détournements du logiciel

Le logiciel pourrait évoluer jusqu’à reproduire parfaitement la plume d’un auteur, un code ou une base de données. En analysant un texte à compléter, il pourrait ainsi le terminer avec le même ton et avec les mêmes idées, sans que personne ne voie la différence entre la rédaction par un humain et celle générée par l’intelligence artificielle.

Il est impossible de prédire son évolution : fonctionnant sur le principe de machine learning, le logiciel est donc évolutif et autonome. Le langage est ainsi utilisé dans tous les domaines, que ce soit la vie quotidienne, la sphère professionnelle ou même la vie politique d’un pays. Les possibilités d’utilisation semblent donc illimitées.

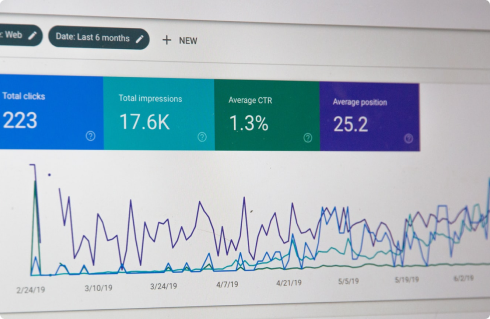

La version bêta privatisée est maintenant accessible pour les entreprises pendant deux mois en test. Les ingénieurs avaient une certaine inquiétude à sortir cette version. En effet, avec de mauvaises intentions, cette technologie pourrait être détournée. En 2019, le directeur stratégique de l’entreprise, Jack Clark, a déclaré : « Nous devons effectuer des expérimentations pour découvrir ce qu’il peut et ne peut pas faire. Il nous faut plus de gens qui testent, pour mieux savoir ce que cela peut faire avec malveillance ». L’utilisation de ce logiciel reste donc très contrôlée.

Le combat d’Elon Musk pour rendre l’IA plus sûre

Depuis quelques années, le PDG de Tesla et de Space X sensibilise face au danger que peut représenter l’intelligence artificielle. Cette sensibilisation s’est intensifiée après la victoire de Open AI face aux meilleurs joueurs de Dota 2, un jeu d’arcade, en 2017. Elon Musk a profité de cet accomplissement pour mettre en garde contre le manque de contrôle autour de l’intelligence artificielle. Il prône une régulation proactive de cette technologie.

En effet, le multi-milliardaire pense que l’évolution de l’intelligence artificielle pourra mener à la disparition de la majorité des métiers. Si cette technologie est capable de compter, lire et écrire, et surtout si elle est capable de raisonnement, alors la plupart des domaines professionnels seront couverts. Elon Musk a déclaré en 2019 : « Le dernier travail qui restera probablement sera le développement de logiciel d’intelligence artificielle, puis l’intelligence artificielle finira par créer son propre logiciel. »

L’intelligence artificielle ne suit plus les règles non officielles de la robotique d’Isaac Asimov. Même si elles sont principalement fictionnelles, les règles du vulgarisateur scientifique et auteur de science-fiction sont souvent reconnues comme base éthique de la robotique.

En 2017, c’est par une série de tweets que l’entrepreneur défendait son point de vue. En août 2019, il déclare lors d’une conférence en Chine : « Je pense que les gens sous-estiment les capacités de l’intelligence artificielle. […] Elle sera bientôt bien plus intelligente qu’un humain moyen. » Habituellement fervent défenseur des nouvelles technologies, son discours pessimiste face à l’intelligence artificielle prouve une inquiétude réelle pour le futur technologique. Selon lui, toute technologie qui risque de mettre l’humain en danger par une mauvaise utilisation ou une évolution trop rapide doit être régulée.